NVIDIA veröffentlicht Nemotron 3 Super: 120B Open-Source-Hybridmodell für fortschrittliche Multi-Agent-Anwendungen

Lesezeit: ca. 8 Minuten

Key Takeaways

- Nemotron 3 Super ist ein neues Open-Source-Modell von NVIDIA mit 120 Milliarden Parametern.

- Das Modell ist speziell für komplexe Multi-Agent-Anwendungen konzipiert und schließt die Lücke zu proprietären Frontier-Modellen.

- Es kommt als Hybridmodell mit Mamba-Attention und MoE-Struktur und verspricht fünffach höhere Durchsatzraten für Agentic AI.

- Die Veröffentlichung platziert Nemotron 3 Super zwischen dem leichten 30B-Modell und schwereren Varianten aus der Nemotron-Reihe.

- Weitere Details sind auf MarkTechPost verfügbar.

Modellcharakteristik: 120 Milliarden Parameter und Hybrid-Architektur

Nemotron 3 Super markiert den nächsten Meilenstein in der Entwicklung großskaliger Open-Source-KI-Modelle und weist beeindruckende 120 Milliarden Parameter auf. Damit stellt es ein mehrfach größeres Modell als das bereits existierende Nemotron 3 mit 30 Milliarden Parametern dar und richtet sich gezielt an Anwendungen, die höchste Anforderungen an Reasoning, Skalierbarkeit und Anpassbarkeit stellen.

Ein wesentliches Merkmal des Modells ist die hybride Architektur, bestehend aus Mamba-Attention-Mechanismen und der Mixture-of-Experts (MoE)-Struktur. Diese Kombination ermöglicht eine effiziente Verarbeitung auch sehr großer und komplexer Datensätze, wie sie in Multi-Agent-Systemen ständig anfallen.

Mamba-Attention unterstützt das Modell dabei, gezielt kontextbezogene Informationen innerhalb von Sequenzen zu beachten und so präzisere Ergebnisse zu generieren. Die MoE-Komponente trägt maßgeblich zur Optimierung der Ressourcenverteilung bei, indem sie die Verarbeitungslast dynamisch auf verschiedene Experten verteilt – ein entscheidender Vorteil bei Anwendungen, die besonders hohe Durchsatzraten verlangen.

Anwendungsfelder: Multi-Agenten-Systeme und Agentic AI

Die Besonderheit von Nemotron 3 Super liegt in seiner Spezialisierung auf komplexe Multi-Agent-Anwendungen. In solchen Umgebungen agieren zahlreiche autonome Agenten miteinander, treffen Entscheidungen, koordinieren sich und reagieren dynamisch auf Veränderungen in Echtzeit.

Ein Vorteil des Modells ist die Fähigkeit, multiple Aufgaben voneinander unabhängig und gleichzeitig zu bewältigen. Die Hybridarchitektur sorgt hierfür nicht nur für ausreichende Kapazitäten, sondern auch für eine flexible Verteilung der Ressourcen, je nachdem, welche Aufgaben gerade verarbeitet werden.

Solche Use-Cases gehören zu den anspruchsvollsten Problembereichen innerhalb der Forschung und Industrie, darunter zum Beispiel:

- Automatisierte Steuerung und Koordination in der Robotik

- Simulationen komplexer Wirtschaftssysteme und Logistiknetzwerke

- Erweiterte Sprach- und Planungssysteme für KI-Assistenten

Leistung und Durchsatz im Vergleich

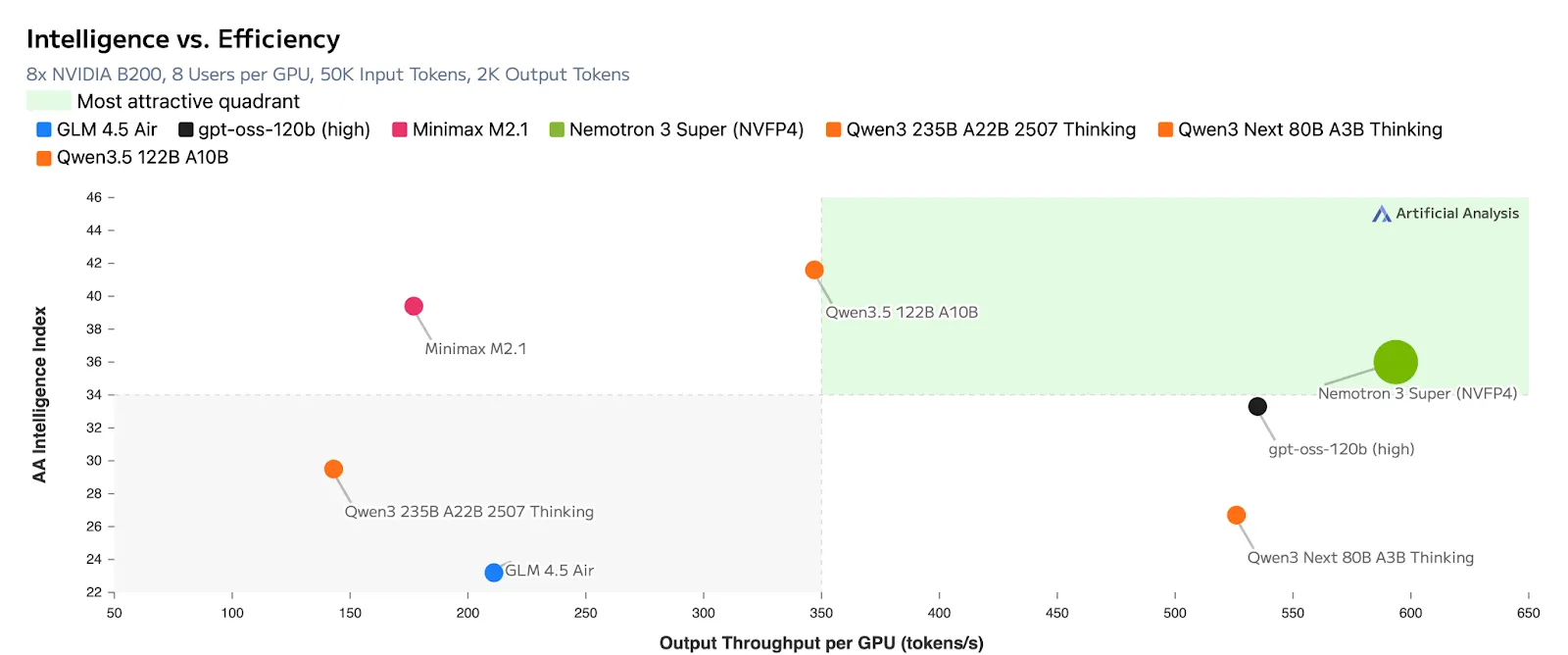

Mit dem Versprechen einer um das Fünffache erhöhten Durchsatzrate („5x Higher Throughput“) setzt NVIDIA neue Maßstäbe für die Verarbeitungsgeschwindigkeit bei Open-Source-Agentic-AI-Lösungen. Dies wird durch die Kombination von Mamba-Attention und der effizient arbeitenden MoE-Struktur ermöglicht, die beide auf parallele Datenverarbeitung mit minimaler Latenz ausgelegt sind.

Gerade im Vergleich zu herkömmlichen Modellen bietet Nemotron 3 Super damit einen erheblichen Performance-Boost – ohne dabei auf proprietäre, geschlossene Lösungen angewiesen zu sein. Somit ist das Modell als Open-Source-Variante besonders attraktiv für Forschung und Industrie, die auf Zugänglichkeit, Transparenz und Anpassungsfähigkeit angewiesen sind.

Transparenz: Open-Source-Ansatz und Positionierung

Die Veröffentlichung von Nemotron 3 Super unter einer Open-Source-Lizenz unterstreicht den Anspruch, Innovationen auf Ebene der Frontier-Modelle für eine breitere Entwickler- und Forschungsgemeinschaft zugänglich zu machen. Damit positioniert sich NVIDIA gezielt zwischen proprietären Vorreitern wie GPT-4 und offenen Community-Initiativen.

Ein zentraler Vorteil: Die Architektur und die Trainingsdaten werden transparent offengelegt, sodass Prüfungen, Audits und individuelle Anpassungen ohne Einschränkungen möglich sind. Die enge Integration in offene Entwicklungsökosysteme fördert wiederum Interoperabilität und beschleunigt die Kollaboration, speziell in Teams und Unternehmen mit höchsten Datenschutz- und Reproduzierbarkeitsanforderungen.

Einordnung innerhalb der Nemotron-3-Familie

Mit seiner Größe von 120 Milliarden Parametern stellt Nemotron 3 Super ein Zwischenstück innerhalb der Nemotron-3-Modellreihe dar. Während das leichte 30B-Modell vor allem für klassische Aufgaben mit geringeren Anforderungen – beispielsweise Mobil-Anwendungen oder kleinere Edge-Devices – konzipiert wurde, zielt die Super-Variante auf die „High-End“-Use-Cases.

Dies eröffnet neuen Spielraum für Entwickler:innen, die Skalierbarkeit und Leistung je nach Bedarf auswählen möchten, ohne sich an proprietäre Angebote binden zu müssen.

Verfügbarkeit und weiterführende Informationen

Nemotron 3 Super ist ab sofort als Open-Source-Modell verfügbar. Damit unterstützt NVIDIA neben Forschungseinrichtungen auch Unternehmen, die auf hochskalierbare KI-Modelle mit umfassender Transparenz setzen.

Detaillierte Hintergründe, technische Zusatzinformationen und die vollständige Ankündigung finden Interessierte auf MarkTechPost. Alle Angaben basieren auf den aktuellen Veröffentlichungen vom 11.03.2026.

Fazit

Mit Nemotron 3 Super setzt NVIDIA ein Zeichen für die fortschreitende Öffnung und Demokratisierung leistungsstarker KI-Modelle. Das Modell vereint Transparenz, Skalierbarkeit und Innovationskraft und ermöglicht es Entwickler:innen und Unternehmen, komplexe Multi-Agent-Anwendungen auf Open-Source-Basis umzusetzen.

Wer mehr erfahren will, findet alle Fakten und die offizielle Meldung auf MarkTechPost.

Bildquelle: https://www.marktechpost.com/2026/03/11/nvidia-releases-nemotron-3-super-a-120b-parameter-open-source-hybrid-mamba-attention-moe-model-delivering-5x-higher-throughput-for-agentic-ai/

What do you feel about this post?

Like

Love

Happy

Haha

Sad