Wie ein risikobewusster KI-Agent mit internem Kritiker, Selbstkonsistenz-Reasoning und Unsicherheitsabschätzung für zuverlässige Entscheidungsfindung gebaut wird

Lesezeit: ca. 14 Minuten

Key Takeaways

- Das Agentensystem integriert einen internen Kritiker und ein Unsicherheitsabschätzungs-Framework, um über einfache Antwortgenerierung hinauszugehen.

- Multi-Sample Inferenz wird simuliert, um mehrere Antwortkandidaten zu bewerten.

- Antworten werden hinsichtlich Genauigkeit, Kohärenz und Sicherheit bewertet.

- Prädiktive Unsicherheit wird mithilfe von Entropie-, Varianz- und Konsistenzmaßen quantifiziert.

- Risikosensitive Auswahlstrategien balancieren das Verhältnis aus Vertrauensniveau und Risikomanagement bei der Auswahl finaler Antworten.

Einleitung

Künstliche Intelligenz (KI)-Agenten sind heute ein wichtiger Bestandteil digitaler Ökosysteme. Mit der zunehmenden Bedeutung von Zuverlässigkeit und Sicherheit entstehen neue Herausforderungen: KI-Systeme müssen nicht nur akkurate Antworten generieren, sondern auch Unsicherheiten erkennen, intern prüfen und verantwortungsbewusste Entscheidungen treffen. Ein fortgeschrittenes System in diesem Kontext verbindet ein internes Kritiker-Modul mit Mechanismen zur Unsicherheitsabschätzung, Multi-Sample-Inferenz und risikoadaptierten Auswahlstrategien.

Agentensystem mit internem Kritiker und Self-Consistency Reasoning

Der Aufbau eines fortschrittlichen Agentensystems erfordert mehr als die reine Generierung von Antworten. Das vorgeschlagene Modell integriert einen internen Kritiker, der mehrfach generierte Antwortkandidaten (candidate responses) auf kritische Qualitätsmerkmale analysiert. Damit wird die reine Reaktionsfähigkeit um Self-Consistency Reasoning erweitert:

- Multi-Sample Inferenz: Das System generiert mehrere unabhängige Kandidatenantworten für dieselbe Eingabe. Dies bildet die Grundlage für eine Studie der Antwortvielfalt und internen Konsistenz.

- Interner Kritiker: Eine dedizierte Komponente bewertet diese Kandidaten entlang zentraler Qualitätsachsen wie Genauigkeit, Kohärenz und Sicherheit. Ziel ist es, nicht nur eine plausible, sondern die konsistenteste und sicherste Antwort zu identifizieren.

Die Verzahnung von internem Kritiker und Self-Consistency Reasoning verschiebt KI-Agents von starren Antwortmustern zu flexibel-analytischen Entscheidungsprozessen – zentrale Voraussetzung für den Praxiseinsatz in sicherheitskritischen Kontexten.

Qualitative Bewertung: Genauigkeit, Kohärenz & Sicherheit

Die Bewertung der Antworten erfolgt entlang dreier zentraler Dimensionen:

- Genauigkeit: Misst die sachliche Korrektheit der Antwort. Ein exakter Abgleich mit validen Wissensquellen ist hier entscheidend.

- Kohärenz: Bewertet die logische Geschlossenheit und Konsistenz zwischen Eingangsdaten, Antwortstruktur und nachfolgenden Aussagen.

- Sicherheit: Erfasst das Potenzial für problematische, unklare oder risikobehaftete Inhalte in den generierten Antworten.

Der interne Kritiker evaluiert jede Kanditatenantwort auf Basis dieser Kriterien und vergibt entsprechende Bewertungen. Schlechte, widersprüchliche oder riskante Antworten werden frühzeitig identifiziert und ausgeschlossen.

Unsicherheitsquantifizierung mittels Entropie, Varianz und Konsistenzmaßen

Zur Beurteilung, wie „sicher“ ein Modell bezüglich seiner Entscheidung ist, werden numerische Unsicherheitsmaße auf die Gesamtheit der Antwortkandidaten angewendet:

- Entropie: Quantifiziert die Unsicherheit der Wahrscheinlichkeitsverteilung über die Kandidatenantworten. Hohe Entropie signalisiert eine Unsicherheit oder Streuung im Antwortpool.

- Varianz: Misst die Schwankung der Scores oder Bewertungen unter den Kandidaten. Hohe Varianz weist auf große Meinungsvielfalt (bzw. wenig Konsens) im System hin.

- Konsistenzmaß: Bewertet, inwieweit sich die generierten Antworten ähneln bzw. eine hohe Übereinstimmung erzielen. Niedrige Konsistenz kann auf uneindeutige oder zu wenig robuste Entscheidungsgrundlagen deuten.

Durch diese mehrdimensionale Quantifizierung kann das Agentensystem seine Zuverlässigkeit gegenüber Nutzern und Anwendungen transparent machen – ein wesentlicher Baustein für vertrauenswürdige KI.

Risikosensitive Auswahlstrategie: Balancierte Entscheidungsfindung

Das finale Ziel ist die Auswahl einer Antwort, die das bestmögliche Verhältnis aus qualitativer Güte und geringer Unsicherheit garantiert. Hierbei kommen risikosensitive Auswahlstrategien zur Anwendung:

- Abgleich von Zuversicht und Risiko: Die Antwort mit dem höchsten Score wird nur präferiert, wenn die Unsicherheitsmaße (niedrige Entropie und Varianz, hohe Konsistenz) „grünes Licht“ geben.

- Absenken der Risikobereitschaft bei kritischen Inhalten: Liegt Unsicherheit jenseits definierter Schwellen, entscheidet der Agent sich bewusst gegen eine finale Antwort oder verweist auf menschliche Expertise.

Dieses Vorgehen ist gerade für Anwendungen relevant, in denen Fehlentscheidungen weitreichende Konsequenzen haben könnten (z. B. Medizin, autonomes Fahren, Recht).

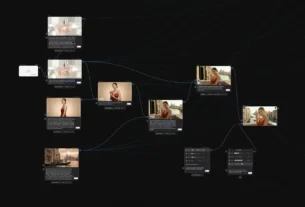

Implementierungsüberblick: Architektur und Workflow

Das Gesamtsystem setzt sich modular zusammen und folgt einem sequentiellen Ablauf:

- Eingabeaufnahme des Nutzer-Inputs.

- Generierung mehrerer Kandidatenantworten über Multi-Sample Inferenz.

- Kritische Bewertung der Kandidaten durch einen internen Kritiker hinsichtlich Genauigkeit, Kohärenz und Sicherheit.

- Berechnung von Entropie, Varianz und Konsistenzkennzahlen zur Unsicherheitsabschätzung.

- Risikosensible Auswahl oder Zurückhaltung – je nach Qualitäts- und Unsicherheitsindikatoren.

Relevanz für die Praxis und Anwendungsbeispiele

Solche fortschrittlichen Agentensysteme sind vor allem in sicherheitskritischen Feldern unverzichtbar, zum Beispiel bei:

- Medizinischer Entscheidungsunterstützung: KI gibt Empfehlungen ab, trifft finale Entscheidungen aber nur bei hoher Zuversicht.

- Autonomen Systemen: Fahrzeuge oder Industrieroboter verweigern Handlungen bei unzureichender Entscheidungsbasis.

- Rechtlicher Beratung: Antworten werden nur weitergegeben, wenn eine hohe Übereinstimmung in der internen Agentenbewertung besteht.

Der Schlüssel liegt im Zusammenspiel aus Transparenz, Selbst-Kritik und Risikomanagement. Nur so lassen sich Fehlerquoten minimieren und Vertrauen aufbauen.

Weiterführende Ressourcen

Ausführliche technische Details und Implementierungsleitfäden finden sich direkt im Originalartikel How to Build a Risk-Aware AI Agent mit Internal Critic, Self-Consistency Reasoning und Uncertainty Estimation for Reliable Decision-Making auf MarkTechPost.

Fazit & Ausblick

Die Kombination aus internem Kritiker, Self-Consistency Reasoning und quantitativer Unsicherheitsabschätzung markiert einen wichtigen Technologiesprung für KI-Agenten. Agentensysteme erhalten dadurch die Fähigkeit, nicht nur akkurat, sondern vor allem verantwortungsvoll und nachvollziehbar zu agieren. Für die nächsten Jahre bleibt spannend, wie sich diese Technologien in Alltagsprodukten, aber vor allem auch in besonders sensiblen Anwendungsfeldern weiter durchsetzen werden.

Weitere Einblicke und konkrete Praxis-Umsetzungen bietet der vollständige Artikel bei MarkTechPost.

Bildquelle: https://www.marktechpost.com/2026/03/09/how-to-build-a-risk-aware-ai-agent-with-internal-critic-self-consistency-reasoning-and-uncertainty-estimation-for-reliable-decision-making/

What do you feel about this post?

Like

Love

Happy

Haha

Sad